Garcelle Beauvais To Host 'Going To Bed With Garcelle' Late-Night Talk Show Podcast For MGM – Deadline

Garcelle Beauvais Speaks On "The Real", RHOBH, Michael Jordan, Will Smith, New Book + More - YouTube

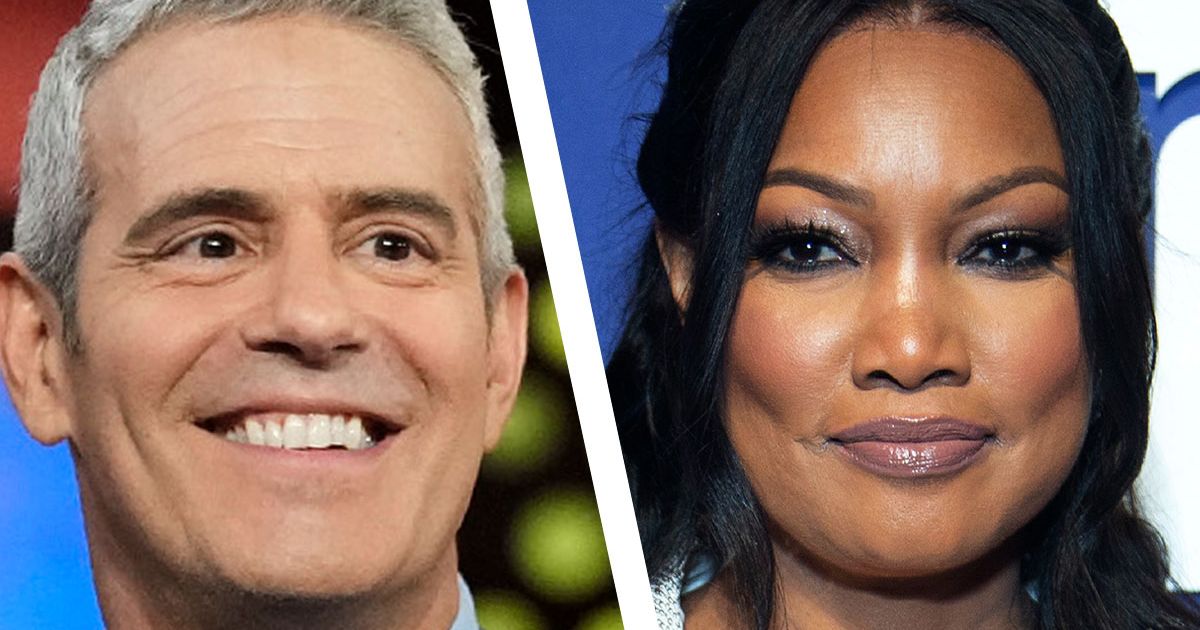

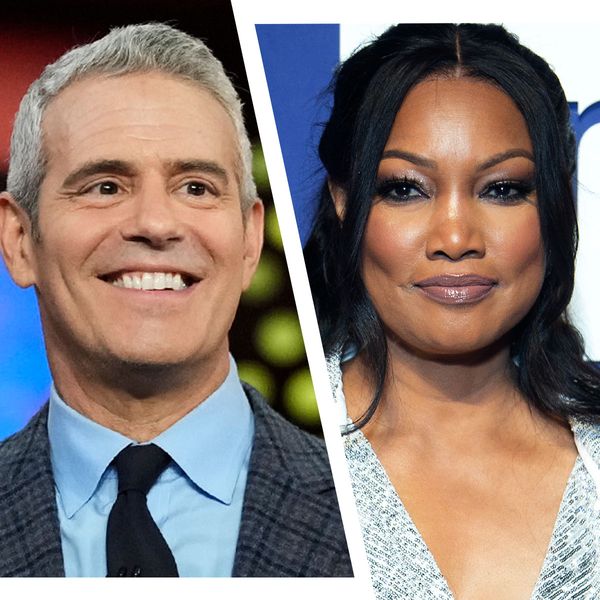

Andy Cohen Apologizes To Garcelle Beauvais Following 'Real Housewives Of Beverly Hills' Reunion Backlash – Deadline

:max_bytes(150000):strip_icc():focal(749x0:751x2)/Andy-Cohen-and-Garcelle-Beauvais-67-25112019-ac3c9694534f4e0c8432c8d7d03dd5c1.jpg)